L’usage du deepfake dans l’art

Article publié le 18 novembre 2025

Temps de lecture : 12 minutes

Article publié le 18 novembre 2025

Temps de lecture : 12 minutes

Propulsé sur le devant de la scène avec la démocratisation de l’IA, le phénomène des deepfakes brouille plus que jamais notre perception du réel. De nombreux artistes s’emparent d’outils de clonage vocal ou visuel : entre critique des technologies et exploration de nouvelles formes d’écriture, iels questionnent les limites de l’authenticité à l’ère des algorithmes. Qui sont ces artistes ? En quoi nous questionnent-ils sur cette ère de la post-vérité ? Plongée dans l’usage artistique du deepfake.

Contraction de “deep”, en référence au deep learning, et de “fake” pour fake news, les deepfakes (ou hyper trucages en français) ont connu, ces derniers mois, une expansion fulgurante. “L’idée est de greffer numériquement une partie d’une image sur une autre, ce qui fonctionne aussi bien pour la vidéo que pour la voix”, explique Gérald Holubowicz, journaliste spécialisé dans les enjeux sociétaux des deepfakes. “Avec le temps, le terme est devenu générique pour désigner toute manipulation vidéo ou altération d’identité à des fins de malversation”, ajoute-t-il. Le deepfake possède en effet cette capacité troublante à remodeler un récit réel, tordre la vérité et en imposer une version alternative. Cette distorsion s’exprime en premier lieu dans le champ de la pornographie, souvent utilisée à des fins de chantage ou de revenge porn. Sur ce terrain, les artistes Émilie Brout et Maxime Marion, ont créé en 2018 Sextape, une vidéo pornographique amateur trouvée en ligne, transformée pour que leurs propres visages y apparaissent. En 2019, Absolutely Yes de Marianne Vieulès, reconstitue une scène d’orgasme censurée du film Extase (1933) de Gustav Machaty.

Le monde politique n’est pas épargné non plus par les deepfakes. En 2018 déjà, le réalisateur américain Jordan Peele alertait sur le danger de ces manipulations avec Obama Deep fake, une vidéo virale où il prenait les traits de l’ancien président pour démontrer, avec alarmisme, la facilité avec laquelle la parole publique peut être falsifiée. En 2019, ce fut la figure de Nixon qui fut détournée dans l’installation In Event of Moon Disaster, de Francesca Panetta et Halsey Burgund du MIT.

Disons-le d’emblée : le deepfake n’est donc pas une invention datant de 2025. Ses fondements techniques existaient déjà auparavant dans l’industrie du cinéma. “C’est plutôt lié aux grands studios d’Hollywood, qui redoutaient de voir disparaître un acteur en plein tournage”, explique Ismaël Joffroy Chandoutis, artiste à la croisée du cinéma et de l’art contemporain, spécialiste du deepfake. Un thème d’ailleurs central dans The Congress (2013) d’Ari Folman, qui anticipait déjà le clonage des acteurs. “À la base, c’est une suite d’outils issus des GAN (réseau antagoniste génératif). Le phénomène s’est démocratisé en 2017 via Reddit, où l’on pouvait déjà les faire tourner sur plusieurs machines”, poursuit Ismaël Joffroy Chandoutis. Ces technologies sont monnaies courantes dans le domaine des effets spéciaux et bien maîtrisées par les expert·es CGI (computer-generated imagery). Conceptuellement, ce clonage numérique n’est pas nouveau. Dès 2012, l’artiste Philippe Parreno explorait déjà la notion de clone vocal avec Marilyn, où un algorithme ressuscitait la voix de Marylin Monroe dans la suite d’un hôtel Astoria qu’elle occupa dans les années 1950. En 2018, avec Meat Puppet, l’artiste américain, Gene Kogan imagine quant à lui, un futur où l’apparence d’une personne pourra être parfaitement imitée grâce à l’apprentissage automatique. Aujourd’hui, les outils ont radicalement changé d’échelle. “Les professionnels des effets spéciaux disposent d’une expertise technique solide, mais avec l’arrivée d’outils comme Sora 2, ces technologies deviennent accessibles à un public bien plus large”, observe Gérald Holubowicz. Une démocratisation qui brouille un peu plus la frontière entre réalité et manipulation.

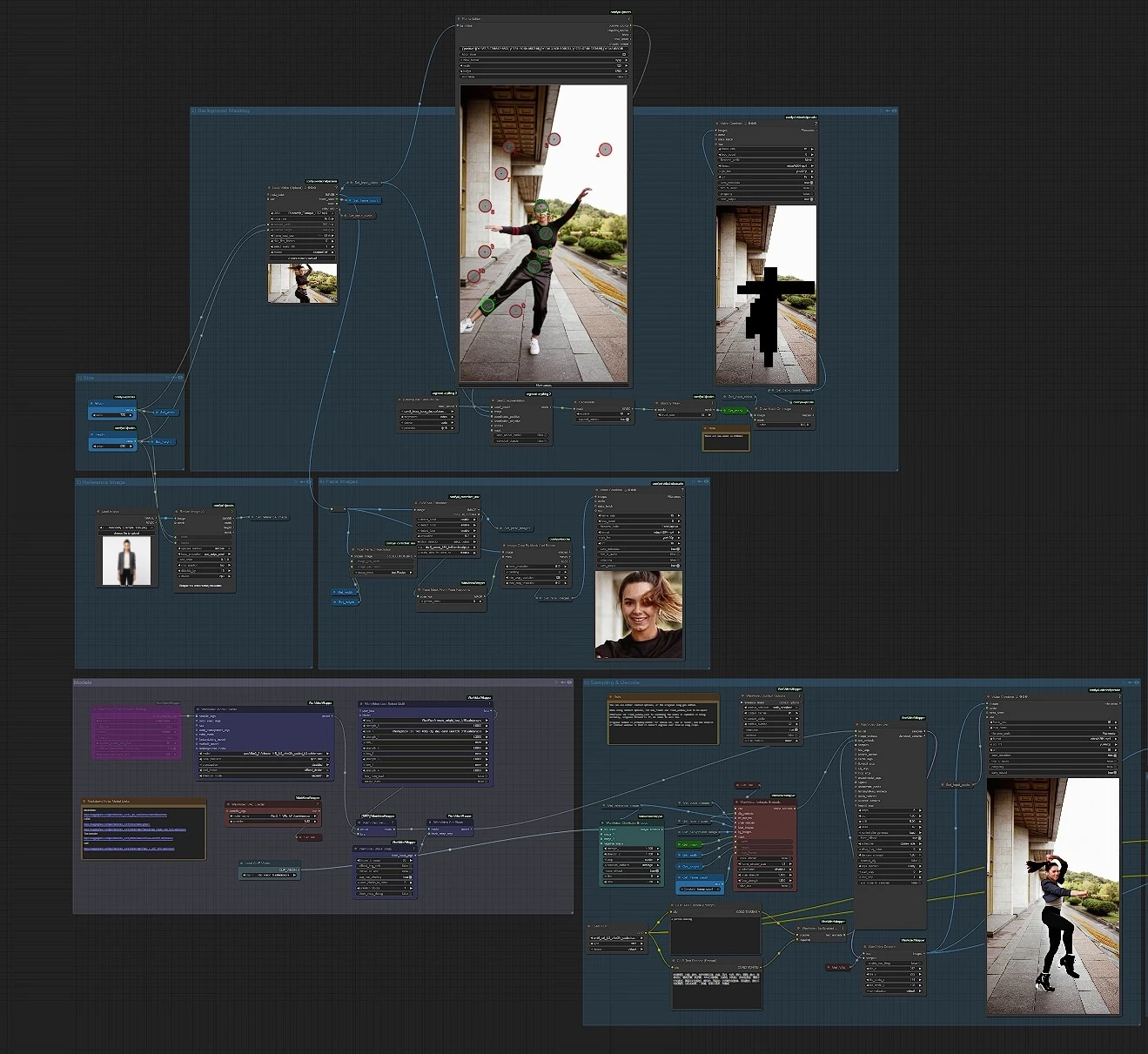

Concrètement, avant 2025, les principaux outils de deepfake visuel reposaient sur des logiciels comme DeepFaceLab ou FaceFusion. Avec ce dernier les manipulations devenaient déjà beaucoup plus accessibles. “Plus besoin d’une centaine de photos, une seule pouvait suffire. Cela demande toujours de la maîtrise, mais le processus était bien plus simple. En revanche, dès qu’il y a du mouvement, la complexité augmente considérablement”, explique Ismaël Joffroy Chandoutis, qui a réalisé des clones IA interactifs d’Alain Damasio ou de David Lynch lors de performances, mais aussi de “clones mentors” telles que Chantal Ackermann, Jean-Claude Carrière ou Aaron Sorkin qui l’accompagnent dans son processus artistique et dialoguer à chaque étape de travail. Une nouvelle vague apparaît en septembre 2025 avec l’intégration directe de l’IA générative dans les outils de vidéo, notamment Wan 2.2 Animate. “On peut désormais utiliser des images de référence pour générer des visuels entièrement trackés. À partir de là, on obtient des mouvements crédibles : le deepfake devient pratiquement indétectable”, poursuit Ismaël Joffroy Chandoutis. Certains artefacts subsistent parfois, des anomalies perceptibles révélant des densités de pixels ou des gradients incohérents. Mais une fois réencodée, la matière est relissée. À tel point qu’une nouvelle discipline apparaît : la deepfake forensic, une investigation numérique menée par des expert·es et des algorithmes d’analyse.

Côté son, le saut technologique est tout aussi spectaculaire. La musicienne DeLaurentis utilise notamment le logiciel Musicfy. “ C’est un outil de clonage vocal très fin. J’ai pu, par exemple, fusionner ma voix avec celle d’un homme. Le résultat garde mes inflexions, mon interprétation… mais le timbre est celui d’un autre corps que le mien, explique t-elle dans le magazine de Trempo, j’ai chanté Billie Jean de Michael Jackson via Musicfy. Évidemment, je suis loin de son registre, mais grâce à l’IA, j’ai trouvé ma personnalité vocale, mon groove, tout en ayant une expressivité qui aurait autrement été inaccessible.” L’auteur-compositeur Benoît Carré, est également un pionnier du clonage vocal et artiste associé au laboratoire Sony CSL. Son projet Chansons impossibles, crée des duos imaginaires entre artistes disparus et musiciens contemporains : Dalida avec PNL, Brassens chantant Angèle, ou Joe Dassin interprétant Papaoutai. “Aujourd’hui on peut convertir une voix, modifier son timbre, avec RVC (retrieval voice conversion). Convertir son timbre en temps réel demande de grandes capacités de calcul et engendre des problèmes de latence mais on peut imaginer un futur proche avec des chanteur.ses qui emprunteront le timbre de voix d’autres interprètes, sur scène”, prédit-il. En France, l’IRCAM travaille activement sur la détection de ces manipulations : DeTOX pour la vidéo, BRUEL pour le son. Sa filiale commerciale, IRCAM Amplify, a d’ailleurs lancé AI Music Detector, un logiciel capable d’analyser les empreintes audio et les caractéristiques spectrales d’un morceau pour déterminer, avec une précision supérieure à 97,8 %, s’il a été généré par une intelligence artificielle ou interprété par des musiciens humains.

Si, d’ordinaire, le deepfake est un outil de contrôle ou d’usurpation de l’identité, il devient pour les artistes un espace d’expérimentation et de critique. Il s’agit alors de se réapproprier les outils, de montrer les limites et de suggérer les problèmes sociétaux du deepfake. Autrement dit, le deepfake artistique relève du métadiscours, un moyen de montrer la manipulation plutôt que de la dissimuler. Le chercheur Vivien Lloveria l’exprime avec justesse dans son article Le deepfake et son métadiscours : l’art de montrer que l’on ment (Interfaces numériques, 2022). Il s’appuie sur les travaux de Monika Bickert, responsable de la sécurité chez Facebook, qui distingue le deepfake du “cheapfake” : dans ce dernier cas, les images trahissent volontairement leurs imperfections, laissant percevoir les artefacts de la falsification. “Une quantité de métadiscours textuels et visuels cherchent alors à apprendre au public à lire ces signes de la manipulation nichés dans les défauts de l’image”, écrit le chercheur. Cette stratégie artistique trouve un écho dans l’oeuvre Z32 d’Avi Mograbi (Le Fresnoy, 2008), film où un jeune soldat israélien témoigne d’un meurtre commis pendant son service militaire. Pour préserver son anonymat, Avi Mograbi recourt à un deepfake dont l’image se fissure par endroits, laissant apparaître les failles du masque numérique. Une approche que partage Ismaël Joffroy Chandoutis, dont les recherches sur la figure de Joshua Ryne Goldberg, l’un des trolls les plus prolifiques d’Internet, explorent les zones de brouillage de l’identité. “Demander à quelqu’un d’incarner une figure aux mille visages me paraît juste, d’un point de vue conceptuel. Je ne veux pas d’une technologie hollywoodienne : je veux que le masque se brise. Cette technologie n’est qu’un simulacre, et c’est précisément là qu’elle devient intéressante, au moment où l’on comprend qu’elle n’est qu’illusion.”

L’artiste et chercheuse Alizée Armet, qui a consacré une partie de sa thèse au deepfake invite à cette même reflexivité. “Mon approche consiste à envisager le deepfake comme un espace de cohabitation entre le vivant et le computationnel, où le geste artistique devient un terrain d’échanges issu de la technopoïesis. Loin de se limiter à révéler le faux, ces pratiques permettent de penser l’émergence d’images et de formes sensibles non humaines, ouvrant à de nouvelles modalités d’existence et de co-création avec la machine.”

La question de l’identité est abordée avec plus ou moins de réalisme par d’autres artistes. En 2021, l’artiste chercheuse et musicienne anglaise Holly Herndon lance le projet Holly+, Elle crée alors un jumeau numérique de sa voix (digital twin) : n’importe quel fichier audio peut être transformé pour être chanté avec la voix de l’artiste. Elle en propose une démonstration avec une reprise de Jolene de Dolly Parton, entièrement recréée par son clone vocal. Un geste d’auto-expropriation consentie, où l’artiste explore la dépossession de sa propre identité comme terrain de création. D’autres choisissent la voie de la parodie ou du contre-pouvoir. Albertine Meunier, dans sa série I am a Grok con, tourne en dérision la figure d’Elon Musk. L’artiste et chercheur Bill Posters détourne, lui aussi, des visages politiques ou médiatiques pour interroger les mécanismes de persuasion et de désinformation à l’œuvre dans l’espace public en ligne. Ses deepfakes de Kim Kardashian ou Mark Zuckerberg mettent ainsi en scène, avec ironie, la fabrication du pouvoir médiatique.

Plus largement, ces expérimentations invitent à repenser la notion de double et de l’incarnation numérique. Ces questionnements dépassent le champ des arts numériques pour s’étendre à d’autres disciplines comme le théâtre. Le collectif Obvious, en collaboration avec la Sorbonne Université, a par exemple recréé un clone numérique de Molière autour d’une hypothèse : qu’aurait écrit l’auteur s’il avait vécu au-delà de 1673 ? De son côté, la metteure en scène Christine Armanger, de la [Compagnie Louve], imagine cloner la voix de Marilyn Monroe sur sa création de dIAboli ou ressusciter la danseuse Isadora Duncan dans de faux films d’archives du début du XXe siècle (The Mirage Factory). Ou comme avec To Be A Machine 2.0, de la compagnie Dead Centre où l’artiste Antoine Vanel, utilise le visage de chaque spectateur pour le rendu de son propre film VR. Autant de créations qui déplacent les frontières entre mémoire et fiction, et qui questionnent la notion d’identité.

Le deepfake s’inscrit finalement dans un cadre plus large : celui de la post-vérité, où la simple maîtrise des réseaux sociaux peut suffire à produire une manipulation de masse. Il demeure néanmoins l’un des outils les plus puissants – et peut-être les plus ambigus – de distorsion du réel. Le collectif U2P050 détourne des figures de pouvoir en générant des images de responsables politiques s’embrassant, notamment dans sa série Smack Dat. Leur film You Are Very Special, documente l’attaque du capital par les partisans de Trump, à partir d’une collection d’archives visuelles et sonores produites par intelligence artificielle après une recherche documentaire de plus de deux ans. Une démarche proche du deepfake, pour autant, le collectif ne semblent pas nécessairement attachés à cette notion, préférant parler de “vérité synthétique dans le cadre d’une question plus large sur les redéfinitions de l’épistémè contemporain”, comme le commente le collectif. Journal of a Self Improvement, une série de quatre expériences deepfakes des artistes chercheur·euses Sylvie Boisseau, Frank Westermeyer, David Zerbib (HEAD), spécule sur cette même réflexion. « Comment explorer concrètement notre rapport à l’image, qui est en train de changer radicalement ? Quels nouveaux espaces de jeu, de doute, de questionnement en résultent ? » interroge Frank Westermeyer.

Dans notre monde saturé de deepfakes, l’attention et la perception deviennent, somme toute, des terrains fragiles, où vérité et fiction s’entremêlent. Pour paraphraser la théorie de l’artiste Hito Steyerl : les images ne se contentent plus de présenter la réalité, elles la créent. Tous ces artistes cité·es, manipulant de plus ou moins près le deepfake, ont un mérite immense… celui de nous interroger sur ce paradigme radicalement nouveau.

Adrien Cornelissen